728x90

if self.reducer._rebuild_buckets():

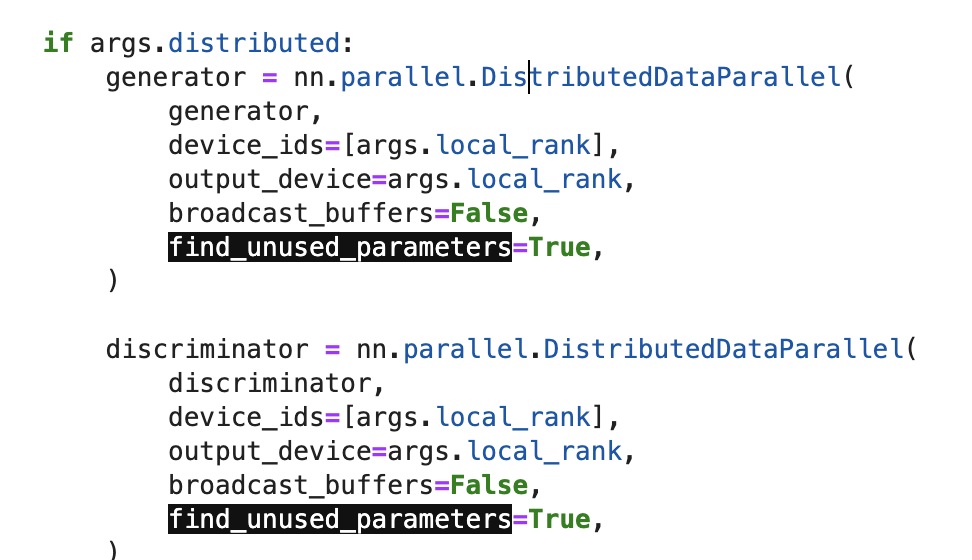

RuntimeError: Expected to have finished reduction in the prior iteration before starting a new one. This error indicates that your module has parameters that were not used in producing loss. You can enable unused parameter detection by (1) passing the keyword argumentere not used in producing loss. You can enable unused parameter detection by (1) passing the keyword argument `find_unused_parameters=True`torch.nn.parallel.DistributedDataParallel`; (2) making sure all `forward` function outputs participate in calculating loss.

이런 에러인데, DistributedDataParallel 호출시 keyword 인자로 find_unused_parameters=True로 주면된다.

'Data-science > deep learning' 카테고리의 다른 글

| [pytorch] stylegan2 여러 지표들 용어 정리. real score? fake score? (0) | 2020.12.31 |

|---|---|

| [pytorch] stylegan2 학습, freezeD + freezeG 동시 적용 (6) | 2020.12.30 |

| [pytorch] 강아지 스타일 합성 stylegan2 freezeD + freezeG ( freezing layer 시행 착오) (0) | 2020.12.28 |

| [stylegan2] ada 논문 다시보기 & afhq + ada + freezeD (0) | 2020.12.28 |

| [pytorch] 유명인 합성 stylegan2 freezeD + freezeG ( freezing layer 시행 착오) (0) | 2020.12.27 |